Hunyuan Image 3.0 da Tencent lidera o LMArena—Um modelo de código aberto

- O que aconteceu

- Por que isso importa

- Sob o capô (resumo rápido)

- O que falta (por enquanto)

- Como isso afeta os criadores do GoEnhance

- Experimente / Acompanhe

GoEnhance Newsroom — 5 de outubro de 2025 (PT)

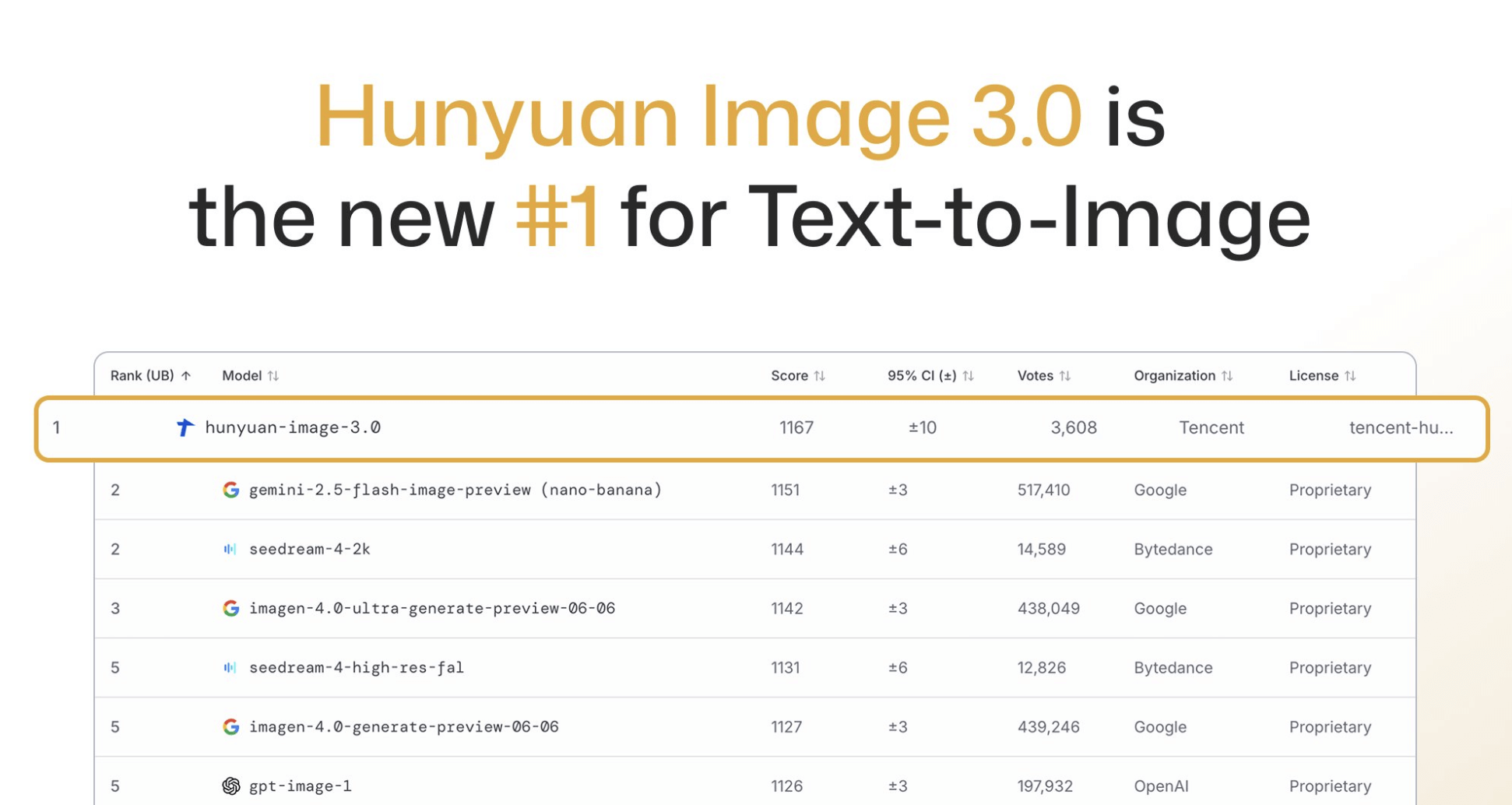

Em um marco para a IA de código aberto, Hunyuan Image 3.0 da Tencent alcançou o #1 no ranking de Texto-para-Imagem do LMArena, superando concorrentes como o "nano-banana" do Google (Gemini 2.5 Flash Image Preview) e o Seedream da ByteDance—baseado em batalhas de votos cegos de humanos. (LMArena)

O que aconteceu

- Mudança no ranking: O ranking ao vivo do LMArena agora lista o hunyuan-image-3.0 no topo entre 26 modelos, com classificações impulsionadas por milhões de votos de usuários em vez de benchmarks sintéticos. (LMArena)

- Ascensão rápida: A equipe do Hunyuan da Tencent e o LMArena anunciaram a conquista do #1 no final de semana, chamando-a de "um grande feito." (X (anteriormente Twitter))

- Código aberto e recente: O código e os pesos do modelo foram lançados no final de setembro e rapidamente subiram nos rankings da comunidade. (GitHub)

Por que isso importa

- Vitória da comunidade: Um modelo de código aberto e nível comercial agora lidera uma arena de preferência humana que era dominada por sistemas proprietários—um ponto de inflexão para desenvolvedores que valorizam transparência e hospedagem própria. (LMArena)

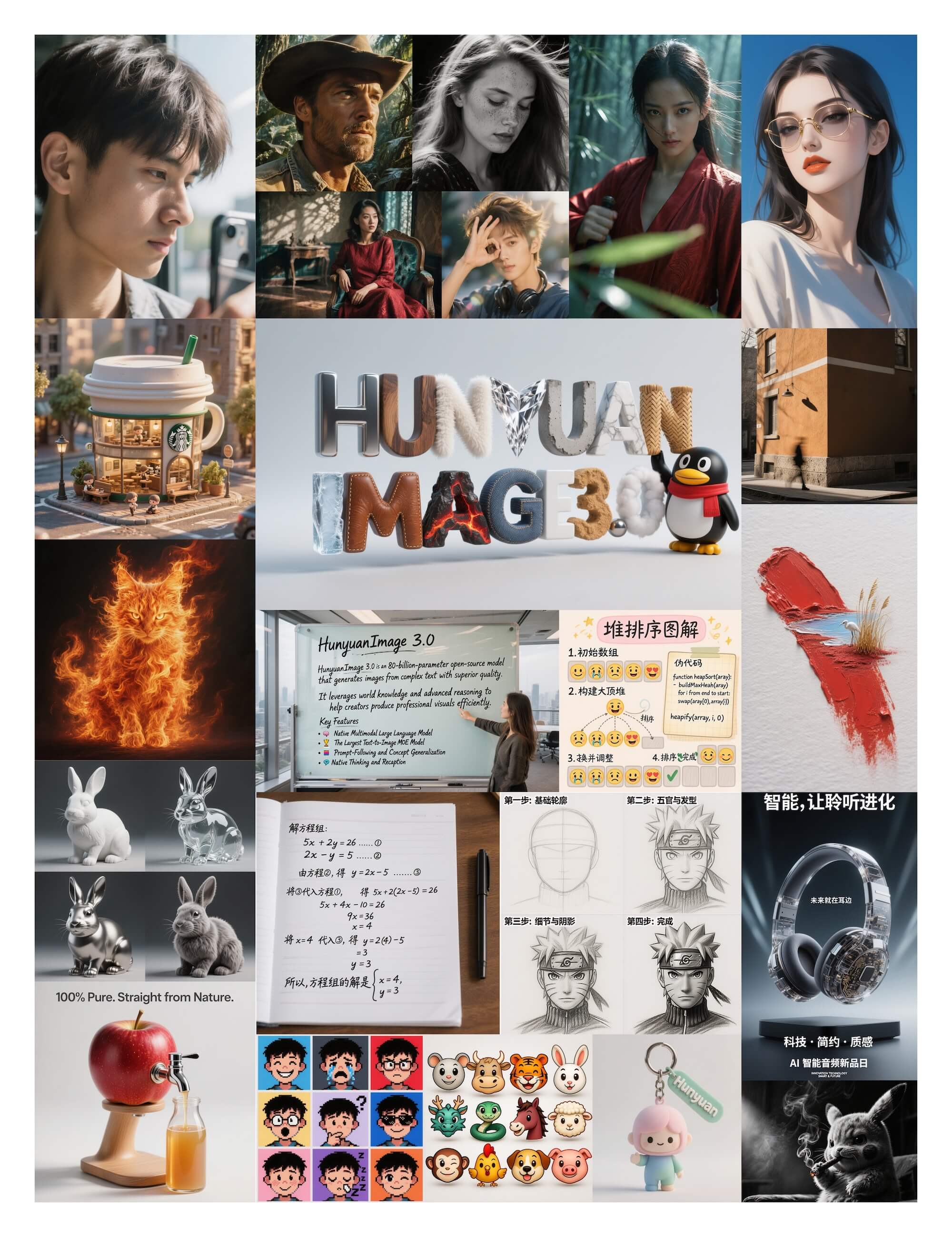

- Pronto para produção: Testadores iniciais destacam renderização de texto nítida, forte controle semântico e estética consistente—áreas onde os modelos abertos tradicionalmente ficavam atrás. (Skywork)

Sob o capô (resumo rápido)

- Multimodal nativo, design MoE: O Hunyuan Image 3.0 usa uma arquitetura Mixture-of-Experts (≈80B parâmetros no total, ~13B ativos por token) que unifica a compreensão de linguagem com a geração de imagens em um único transformador autorregressivo—sem codificador de texto separado. (Hugging Face)

- Atenção causal generalizada: Os tokens de texto seguem atenção causal (estilo LLM), enquanto os tokens de imagem recebem contexto global—melhorando o alinhamento de raciocínio e a coerência espacial nas imagens. (arXiv)

- Codificação posicional 2D e forma automática: O modelo introduz RoPE 2D para imagens e pode prever proporção/resolução a partir do contexto quando você não especifica—útil para fluxos de trabalho criativos. (arXiv)

O que falta (por enquanto)

A Tencent confirma que a versão atualmente lançada foca em Texto-para-Imagem. Edição de imagem, imagem-para-imagem e interações em múltiplos turnos estão planejadas para versões futuras. Se você depende de operações de edição (inpainting, retoque, transferência de estilo), mantenha sua cadeia de ferramentas existente enquanto o ecossistema evolui. (Futu News)

Como isso afeta os criadores do GoEnhance

- Melhor tipografia e controle de prompts longos: Se suas campanhas precisam de texto em nível de pôster ou briefings criativos densos, os pontos fortes do Hunyuan 3.0 se aplicam diretamente a casos de uso como criação de anúncios, arte-chave e packshots. (Skywork)

- Caminhos de implantação de código aberto: Equipes que hospedam seus próprios sistemas podem avaliar as compensações de latência/custo graças aos pesos abertos e truques de eficiência MoE observados por primeiros adotantes. (GitHub)

Experimente / Acompanhe

- Veja o ranking ao vivo e exemplos no quadro de Texto-para-Imagem do LMArena. (LMArena)

- Explore o cartão do modelo e os pesos no Hugging Face e no GitHub oficial para detalhes de configuração e atualizações. (Hugging Face)

- Anúncio oficial e destaques da Tencent Hunyuan no X. (X (anteriormente Twitter))

Nota do editor (GoEnhance)

Estamos avaliando o Hunyuan Image 3.0 em nosso conjunto de benchmarks internos ao lado de modelos da família Flux, Seedream e outros. Por enquanto, você pode continuar criando com nosso Gerador de Imagens por IA e ferramentas de vídeo, e compartilharemos atualizações de integração assim que estiverem prontas para produção.

Fontes: ranking e anúncios do LMArena; posts da Tencent Hunyuan; cartão do modelo no Hugging Face; repositório no GitHub; análises técnicas de terceiros e reportagens. (LMArena)